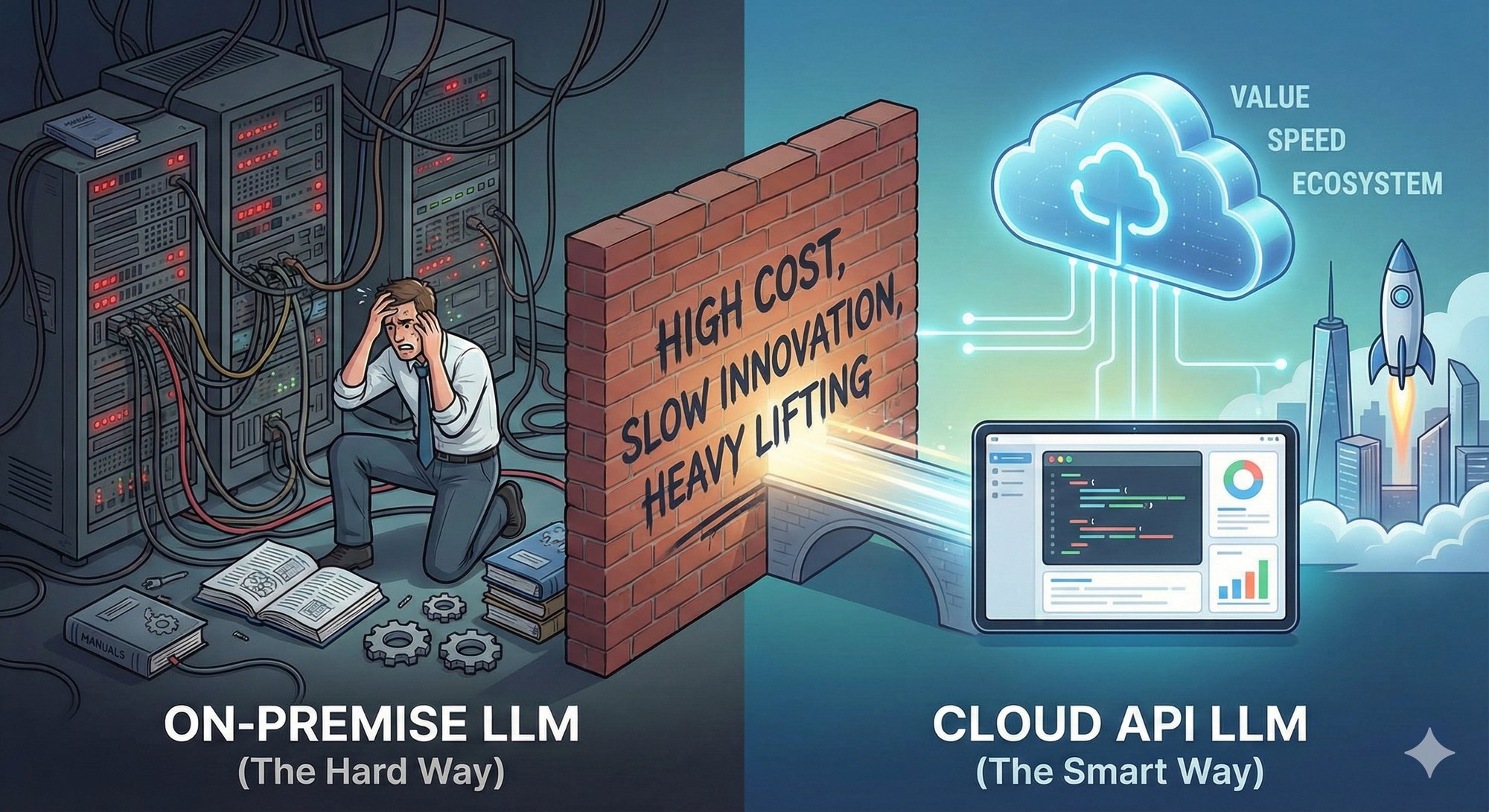

Die Illusion, Ihr eigenes LLM zu bauen: Warum das Mieten von Intelligenz die klügste Strategie ist

Bauen Sie kein 'Rechenzentrum' im KI-Zeitalter. Lernen Sie aus der Cloud-Revolution.

Ich höre oft von Unternehmensführern und Technikleitern: "Wir wollen unser eigenes On-Premise-LLM bauen, um unsere Daten zu schützen und auf unsere spezifischen Bedürfnisse zu optimieren."

Um es deutlich zu sagen: Hören Sie sofort auf. Es sei denn, Sie arbeiten unter extrem strengen regulatorischen Rahmenbedingungen – wie denen, die eine Banklizenz erfordern, bei denen Daten strikt nicht die Räumlichkeiten verlassen dürfen – ist es irrational, Ihr eigenes LLM in Bezug auf Kosten, Effizienz und technische Schulden zu bauen.

Wir haben diesen genauen Zyklus vor einem Jahrzehnt durchlebt. Als AWS und Google Cloud aufkamen, bestanden viele Unternehmen darauf, ihre eigenen Serverräume zu behalten, unter Berufung auf "Sicherheit". Letztendlich sind sie alle in die Cloud migriert, um bessere Sicherheit und Skalierbarkeit zu erreichen. Der LLM-Markt folgt genau demselben Verlauf.

1. Das ungewinnbare Rennen gegen die Innovationsgeschwindigkeit

Stellen Sie sich vor, Sie verbringen sechs Monate damit, Ihr eigenes Modell zu trainieren und zu optimieren. Zu dem Zeitpunkt, an dem Sie es bereitstellen, wird OpenAI oder Google bereits die nächste Generation von Modellen veröffentlicht haben, die intelligenter, schneller und günstiger sind. In dem Moment, in dem Sie sich entscheiden, intern zu bauen, treten Sie in ein "Leistungsrennen" gegen große Technologieunternehmen ein. Dies ist ein Kampf, den Sie nicht gewinnen können. Durch die Verwendung von APIs können Sie jedoch sofort auf die neueste SOTA (State-of-the-Art) Leistung aufrüsten, indem Sie nur eine einzige Zeile Code (die Modell-ID) ändern. Der klügste Weg, mit Innovation Schritt zu halten, besteht nicht darin, sie zu 'besitzen', sondern sie zu 'nutzen'.

2. Die Spitze des Eisbergs: Das Modell ist nur der Anfang

Das Bauen des LLM ist nicht das Ende. Moderne KI-Anwendungen erfordern viel mehr als nur Textgenerierung.

- RAG (Retrieval-Augmented Generation): Vektordatenbanken erstellen, um Antworten in Ihren internen Dokumenten zu verankern.

- Websuche: Echtzeitsuche integrieren, um Halluzinationen zu reduzieren und aktuelle Informationen bereitzustellen.

- Funktionsaufrufe: Der KI ermöglichen, mit anderer Software und APIs zu interagieren.

Kommerzielle API-Anbieter bieten diese Funktionen als integriertes Ökosystem an. Wenn Sie intern bauen, sind Sie damit belastet, all diese zusätzliche Infrastruktur von Grund auf zu entwickeln, zu debuggen und zu warten. Dies ist "Undifferentiated Heavy Lifting" – Arbeit, die keinen einzigartigen Wert für Ihr Kerngeschäft hinzufügt.

3. Kostenasymmetrie: CapEx vs. OpEx

Das Bauen im Haus fängt Sie in massiven Fixkosten (CapEx) ein. Sie müssen teure GPU-Cluster kaufen oder mieten und ein Team hochbezahlter KI-Ingenieure einstellen, um diese zu warten. Die Zähler laufen, selbst wenn Ihre Benutzer schlafen. Im Gegensatz dazu arbeiten APIs auf variablen Kosten (OpEx). Sie zahlen nur für das, was Sie nutzen. Mit der schnellen Kommodifizierung von KI sinken die Tokenpreise drastisch. Für die meisten Unternehmensverkehrsvolumina sind die Kosten für die Nutzung einer API überwältigend niedriger als das Betreiben und Kühlen Ihrer eigenen Server rund um die Uhr.

4. Der Mythos der Datensicherheit

Die Sorge, dass "ich nicht möchte, dass meine Daten verwendet werden, um die KI zu trainieren", ist berechtigt, aber die Lösung, intern zu bauen, ist oft fehlgeleitet. Aktuelle Enterprise-grade LLM APIs (über AWS, Azure, Google Cloud) garantieren rechtlich Null Datenspeicherung – das bedeutet, dass Ihre Daten niemals für das Modelltraining verwendet werden. Denken Sie darüber nach: Ist es sicherer, Sicherheitsupdates auf Ihren eigenen Servern zu verwalten und Risiken einzugehen, oder Private Endpoints auf der Sicherheitsinfrastruktur zu nutzen, die von den besten Sicherheitsexperten der Welt bei großen Technologieunternehmen geschützt wird?

5. Fazit: Konzentrieren Sie sich auf Wert, nicht auf Infrastruktur

Ihren Kunden ist es egal, welches Modell Sie verwenden. Sie interessieren sich nur für den Wert, den dieses Modell ihnen bietet. Verschwenden Sie keine Zeit damit, das Rad neu zu erfinden. Mieten Sie die besten "Gehirne" (LLMs), die verfügbar sind, verbinden Sie sie mit Ihren einzigartigen Daten und konzentrieren Sie sich darauf, den Service zu entwickeln, den Ihre Kunden wünschen. Der Gewinner im KI-Zeitalter ist nicht derjenige, der 'das Modell besitzt', sondern derjenige, der 'das Modell am besten nutzt.'