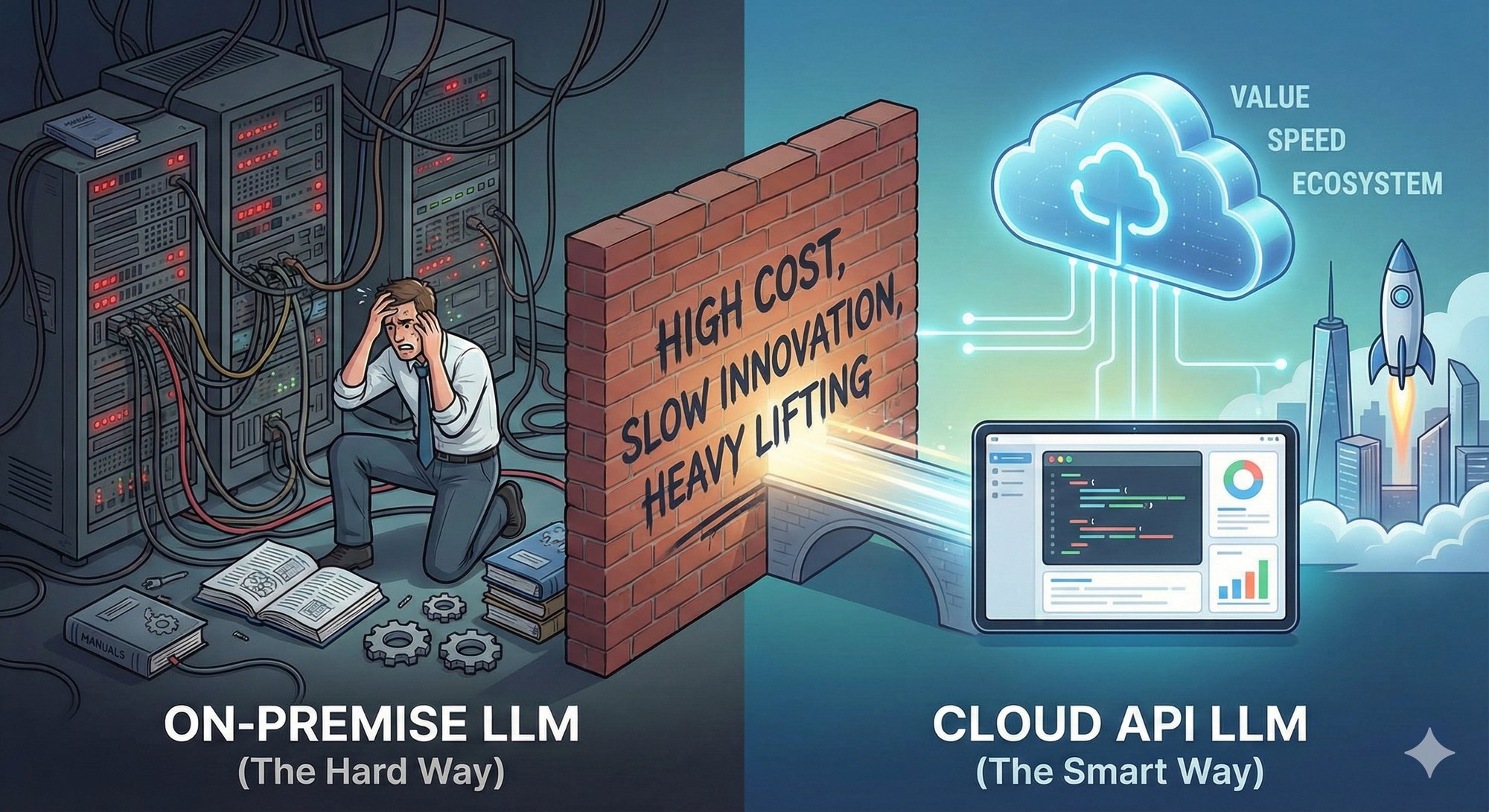

자체 LLM 구축의 함정: 왜 '모델'이 아닌 '서비스'에 집중해야 하는가?

클라우드 시대를 교훈 삼아, AI 시대의 '데이터센터'를 짓는 실수를 반복하지 마십시오.

기업 임원들이나 개발 리더들과 대화하다 보면 종종 듣는 이야기가 있습니다. "우리 회사만의 데이터를 보호하고 최적화하기 위해 자체(On-premise) LLM을 구축하고 싶습니다."

결론부터 말씀드리자면, 지금 멈추십시오. 여러분이 은행 라이선스(Banking License) 수준의 법적으로 데이터 반출이 원천 봉쇄된 규제 환경에 있는 것이 아니라면, 자체 LLM 구축은 비용, 효율, 기술 부채 모든 면에서 비합리적인 선택입니다.

우리는 이미 10년 전, 비슷한 경험을 했습니다. AWS나 구글 클라우드가 등장했을 때도 많은 기업이 "보안"을 이유로 자체 서버실을 고집했지만, 결국 더 안전하고 효율적인 클라우드로 넘어왔습니다. LLM 시장도 이와 똑같은 길을 걷고 있습니다.

1. '따라잡을 수 없는' 혁신의 속도

여러분이 6개월을 들여 자체 모델을 학습시키고 최적화했다고 가정해 봅시다. 그 모델이 완성되어 배포될 시점이면, OpenAI나 Google은 이미 그다음 세대의, 훨씬 더 똑똑하고 저렴한 모델을 내놓습니다. 자체 구축을 선택하는 순간, 여러분은 빅테크 기업들과 **'모델 성능 경쟁'**을 해야 합니다. 이것은 승산이 없는 싸움입니다. 대신 API를 사용하면, 새로운 모델이 나올 때마다 코드 한 줄(Model ID)만 바꿔서 즉시 최고의 성능을 누릴 수 있습니다. 혁신의 속도를 따라가는 가장 현명한 방법은 '소유'가 아닌 '접속'입니다.

2. 빙산의 일각: 모델은 시작일 뿐입니다

자체 LLM을 구축한다고 끝이 아닙니다. 현대적인 AI 서비스는 단순히 텍스트만 생성하지 않습니다.

- RAG (검색 증강 생성): 회사 내부 문서를 검색해서 답변하기 위한 벡터 데이터베이스 구축.

- Web Search: 최신 정보를 실시간으로 검색하여 할루시네이션을 줄이는 기능.

- Function Calling: AI가 다른 소프트웨어나 API를 제어하는 능력.

상용 API 서비스들은 이러한 기능들을 통합된 환경에서 제공합니다. 자체 구축을 하려면 이 모든 주변 인프라를 직접 개발하고, 버그를 수정하고, 유지보수해야 합니다. 이것은 기업의 핵심 비즈니스와 무관한 **'불필요한 과잉 업무(Undifferentiated Heavy Lifting)'**입니다.

3. 비용의 비대칭성: 고정비 vs 변동비

자체 구축은 막대한 **고정 비용(Fixed Cost)**을 요구합니다. 고가의 GPU 서버를 구매하거나 임대해야 하고, 이를 운영할 고액 연봉의 AI 엔지니어 팀을 꾸려야 합니다. 모델을 사용하지 않는 밤 시간대에도 서버 비용은 발생합니다. 반면 API는 **변동 비용(Variable Cost)**입니다. 쓴 만큼만 냅니다. 특히 최근의 상용 모델들은 기술의 발전으로 가격이 급격히 하락하고 있습니다. 대부분의 기업 서비스 트래픽에서 API 비용은 자체 인프라를 24시간 돌리는 비용보다 압도적으로 저렴합니다.

4. 보안에 대한 오해

"내 데이터를 AI 학습에 쓰고 싶지 않다"는 우려는 타당하지만, 해결책이 잘못되었습니다. 현재 AWS, Azure, Google Cloud 등을 통해 제공되는 엔터프라이즈급 LLM API는 **'데이터 학습 금지(Zero Data Retention)'**를 법적으로 보장합니다. 냉정하게 판단해 보십시오. 자체 구축한 서버의 보안 패치를 직접 관리하다 해킹당할 확률과, 세계 최고의 보안 전문가들이 지키는 빅테크 기업의 보안 인프라 위에서 Private Endpoint를 사용하는 것 중 어느 쪽이 더 안전하겠습니까?

5. 결론: 인프라가 아닌 '가치'를 만드십시오

고객은 여러분이 어떤 모델을 쓰는지 궁금해하지 않습니다. 그 모델이 나에게 어떤 가치를 주는지에만 관심이 있습니다. 인프라 구축에 시간을 낭비하지 마십시오. 이미 만들어진 최고의 두뇌(LLM)를 빌려, 여러분만의 데이터를 연결하고, 고객이 원하는 서비스를 만드는 데 집중하십시오. AI 시대의 승자는 '모델을 가진 자'가 아니라, **'모델을 가장 잘 활용하는 자'**입니다.